Una de las mejores herramientas para ejecutar modelos de IA localmente en Mac ha mejorado aún más. Aquí están las razones y cómo se ejecutará.

Los modelos de IA locales con Ollama ahora funcionan más rápido en Macs con silicio de Apple

Si aún no te has encontrado con Ollama, es una aplicación para Mac, Linux y Windows que permite a los usuarios ejecutar modelos de IA localmente en sus computadoras.

A diferencia de las aplicaciones basadas en la nube como ChatGPT, estos modelos no funcionan localmente y requieren una conexión a Internet, Ollama permite a los usuarios cargar y ejecutar modelos directamente en sus máquinas.

Estos modelos se pueden descargar de comunidades de código abierto como Hugging Face o directamente del proveedor del modelo.

Sin embargo, ejecutar LLM localmente puede ser bastante desafiante, ya que incluso los LLM pequeños y ligeros tienden a consumir cantidades significativas de RAM y memoria GPU.

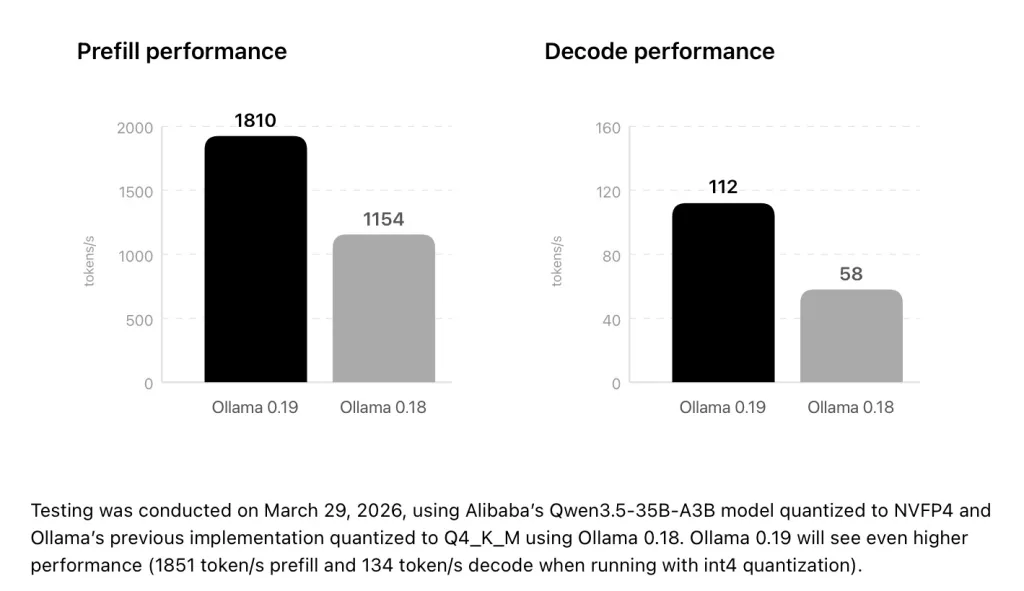

Para superar esta situación, Ollama lanzó una versión preliminar de su aplicación (Ollama 0.19) y esta versión "ahora está construida sobre el marco de aprendizaje automático MLX de Apple, permitiendo así que los modelos de IA locales funcionen más rápido en Macs con silicio de Apple al aprovechar la arquitectura de memoria unificada".

Aquí está Ollama:

Esto está causando un gran aumento de velocidad en todos los dispositivos de Apple Silicon. En los chips M5, M5 Pro y M5 Max de Apple, Ollama acelera el tiempo hasta el primer token (TTFT) y la velocidad de producción por token (tokens/segundo) aprovechando los nuevos Aceleradores de Neural GPU de Ollama.

Con esta actualización, Ollama indica que ahora es más rápido ejecutar asistentes personales como OpenClaw y "agentes de codificación como Claude Code, OpenCode o Codex".

Sin embargo, Ollama recomienda a los usuarios "asegurarse de tener una Mac con más de 32GB de memoria unificada", lo que puede no ser el caso para muchos usuarios que desean ejecutar LLM localmente.

Aún así, puedes seguir este enlace para obtener más información sobre Ollama. Si deseas obtener más información sobre el proyecto MLX de Apple, puedes encontrar todos los detalles aquí.

Productos que valen la pena revisar en Amazon

- David Pogue – 'Apple: The First 50 Years'

- MacBook Neo

- Logitech MX Master 4

- AirPods Pro 3

- AirTag (2ª Generación) – Paquete de 4

- Apple Watch Series 11

- Adaptador CarPlay inalámbrico

Comentarios

(5 Comentarios)