Eines der besten Werkzeuge, um KI-Modelle lokal auf dem Mac auszuführen, ist weiter verbessert worden. Hier sind die Gründe und wie es funktioniert.

Lokale KI-Modelle laufen jetzt schneller auf Apple-Silicon-Macs mit Ollama

Wenn Sie Ollama noch nicht kennengelernt haben, handelt es sich um eine Anwendung für Mac, Linux und Windows, die es Benutzern ermöglicht, KI-Modelle lokal auf ihren Computern auszuführen.

Im Gegensatz zu cloudbasierten Anwendungen wie ChatGPT funktionieren diese Modelle nicht lokal und erfordern eine Internetverbindung. Ollama ermöglicht es Benutzern, Modelle direkt auf ihren Maschinen herunterzuladen und auszuführen.

Diese Modelle können von Open-Source-Communities wie Hugging Face oder direkt vom Modellanbieter heruntergeladen werden.

Das lokale Ausführen von LLMs kann jedoch ziemlich herausfordernd sein, da selbst kleine und leichte LLMs dazu neigen, erhebliche Mengen an RAM und GPU-Speicher zu verbrauchen.

Um dieses Problem zu überwinden, hat Ollama die Vorschauversion seiner Anwendung (Ollama 0.19) veröffentlicht, und diese Version „wurde nun auf Apples Machine Learning Framework MLX aufgebaut, sodass sie von der einheitlichen Speicherarchitektur profitieren kann“, um lokale KI-Modelle auf Apple-Silicon-Macs schneller auszuführen.

Hier ist Ollama:

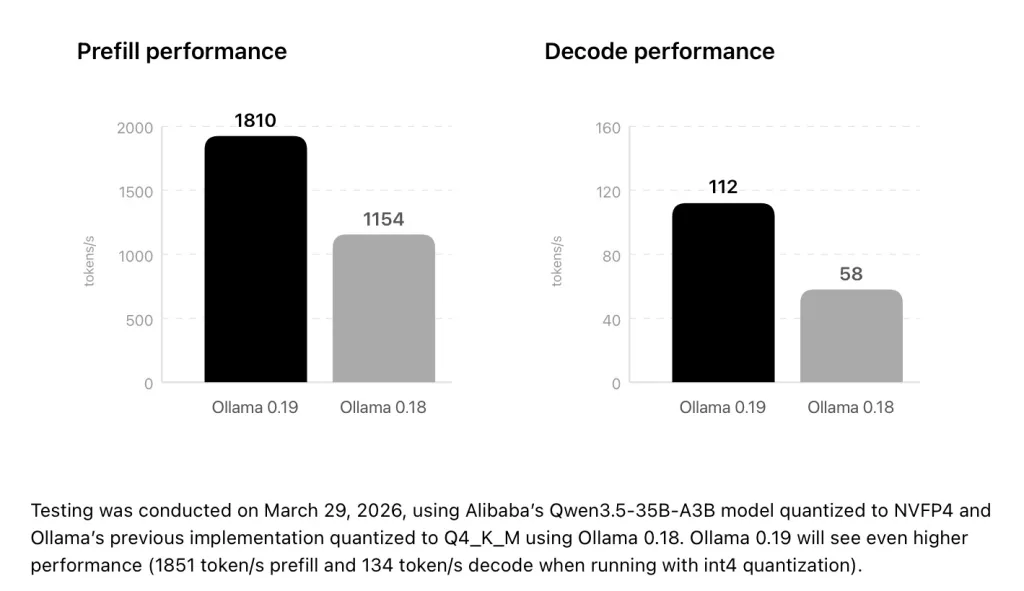

Dies führt dazu, dass Ollama auf allen Apple-Silicon-Geräten einen erheblichen Geschwindigkeitszuwachs erzielt. Auf Apples M5, M5 Pro und M5 Max Chips beschleunigt Ollama die Zeit bis zum ersten Token (TTFT) und die Produktionsgeschwindigkeit pro Token (Token/Sekunde), indem es die neuen GPU-Neural-Akzeleratoren nutzt.

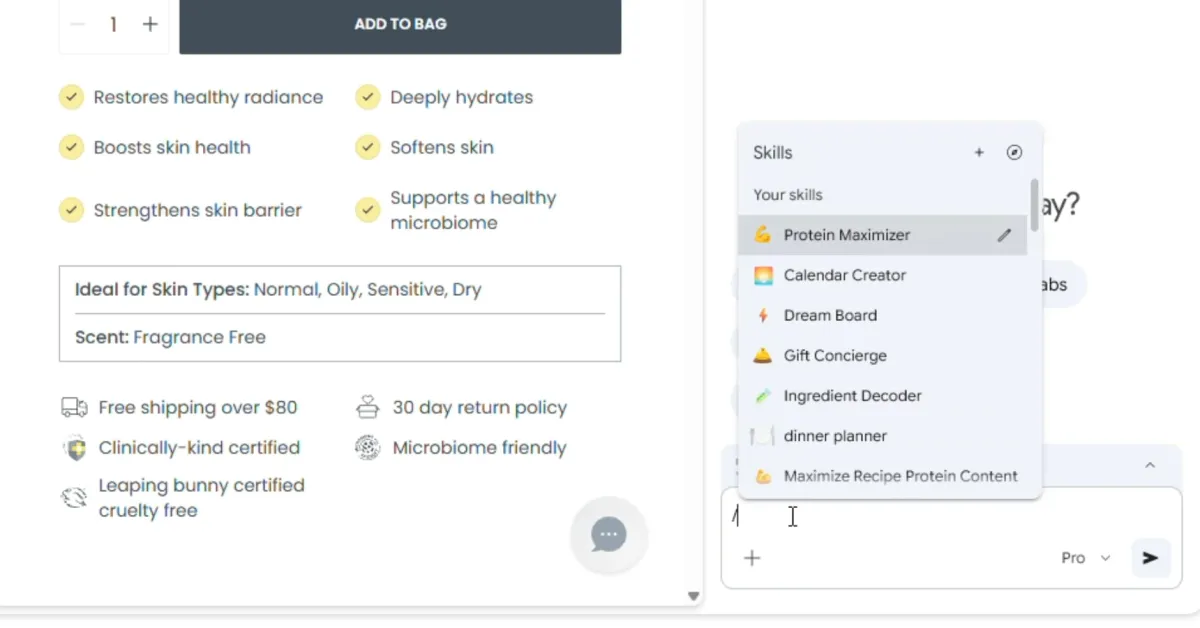

Mit diesem Update gibt Ollama an, dass das Ausführen von persönlichen Assistenten wie OpenClaw und „Codierungsagenten wie Claude Code, OpenCode oder Codex“ jetzt schneller ist.

Allerdings empfiehlt Ollama den Benutzern, „bitte sicherzustellen, dass Sie über einen Mac mit mehr als 32 GB gemeinsamem Speicher verfügen“, was für viele Benutzer, die LLMs lokal ausführen möchten, möglicherweise nicht zutrifft.

Dennoch können Sie diesem Link folgen, um mehr über Ollama zu erfahren. Wenn Sie mehr über Apples MLX-Projekt erfahren möchten, finden Sie hier alle Details.

Produkte, die es wert sind, bei Amazon angesehen zu werden

- David Pogue – ’Apple: Die ersten 50 Jahre’

- MacBook Neo

- Logitech MX Master 4

- AirPods Pro 3

- AirTag (2. Generation) – 4er-Pack

- Apple Watch Series 11

- Drahtloser CarPlay-Adapter

Kommentare

(5 Kommentare)