Un des meilleurs outils pour exécuter des modèles AI localement sur Mac est désormais encore plus performant. Voici pourquoi et comment les exécuter.

Les modèles AI locaux avec Ollama fonctionnent désormais plus rapidement sur les Mac à silicium Apple

Si vous n'avez pas encore découvert Ollama, c'est une application pour Mac, Linux et Windows qui permet aux utilisateurs d'exécuter des modèles AI localement sur leurs ordinateurs.

Contrairement aux applications basées sur le cloud comme ChatGPT, ces modèles ne fonctionnent pas localement et nécessitent une connexion Internet, Ollama permet aux utilisateurs de charger et d'exécuter des modèles directement sur leurs machines.

Ces modèles peuvent être téléchargés à partir de communautés open source comme Hugging Face ou directement auprès du fournisseur de modèles.

Cependant, exécuter des LLM localement peut être assez exigeant, car même les LLM petits et légers tendent à consommer une quantité significative de RAM et de mémoire GPU.

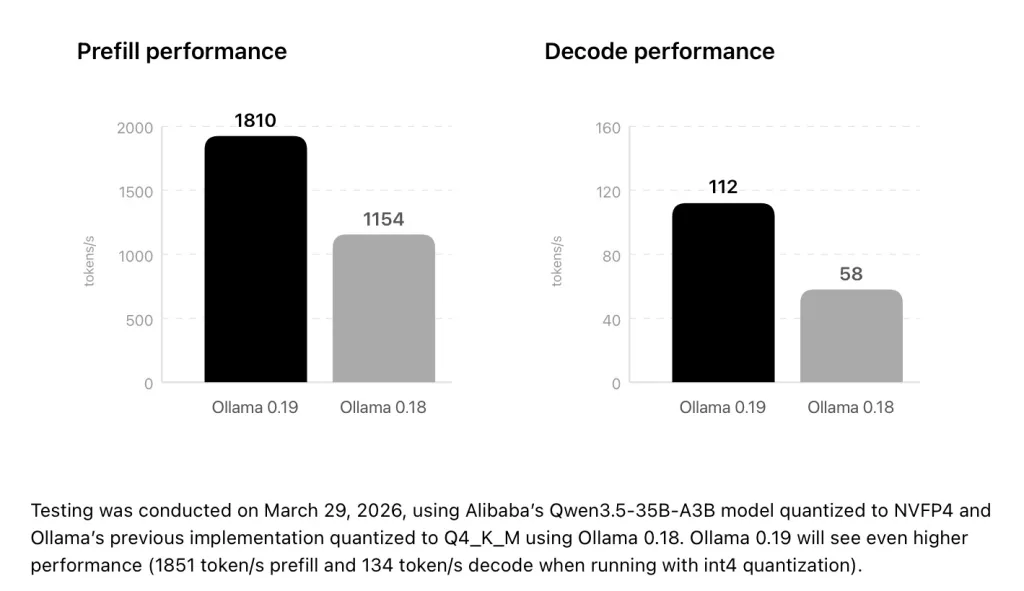

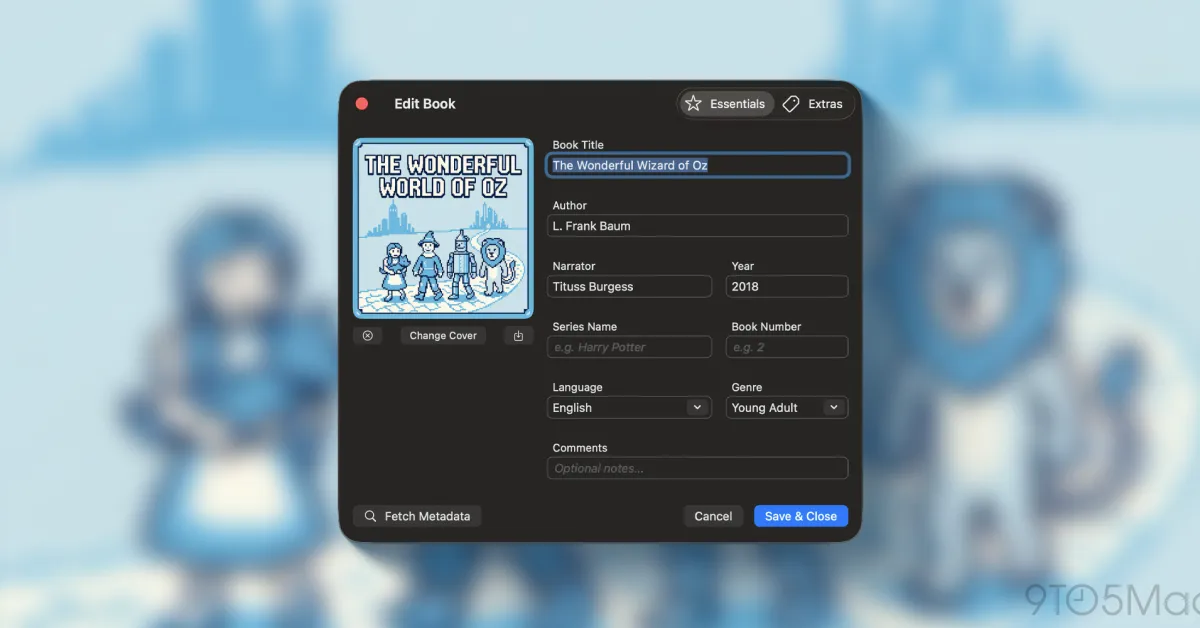

Pour surmonter cette situation, Ollama a publié une version bêta de son application (Ollama 0.19) et cette version est "désormais construite sur le cadre d'apprentissage machine MLX d'Apple, permettant ainsi aux modèles AI locaux de fonctionner plus rapidement sur les Mac à silicium Apple en tirant parti de l'architecture de mémoire unifiée".

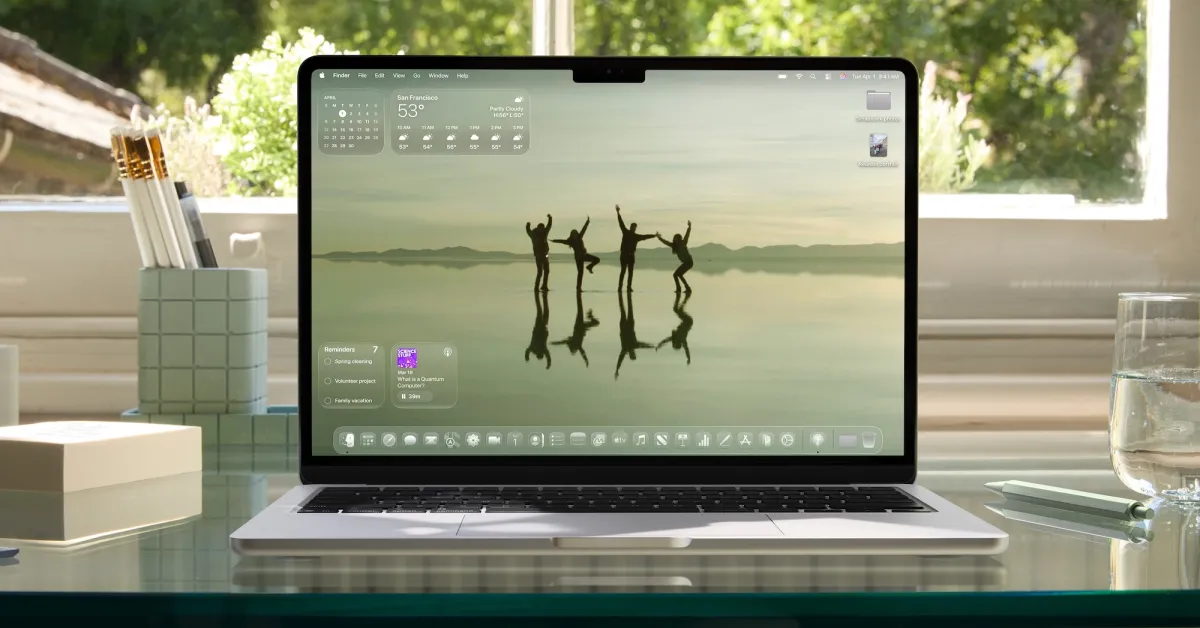

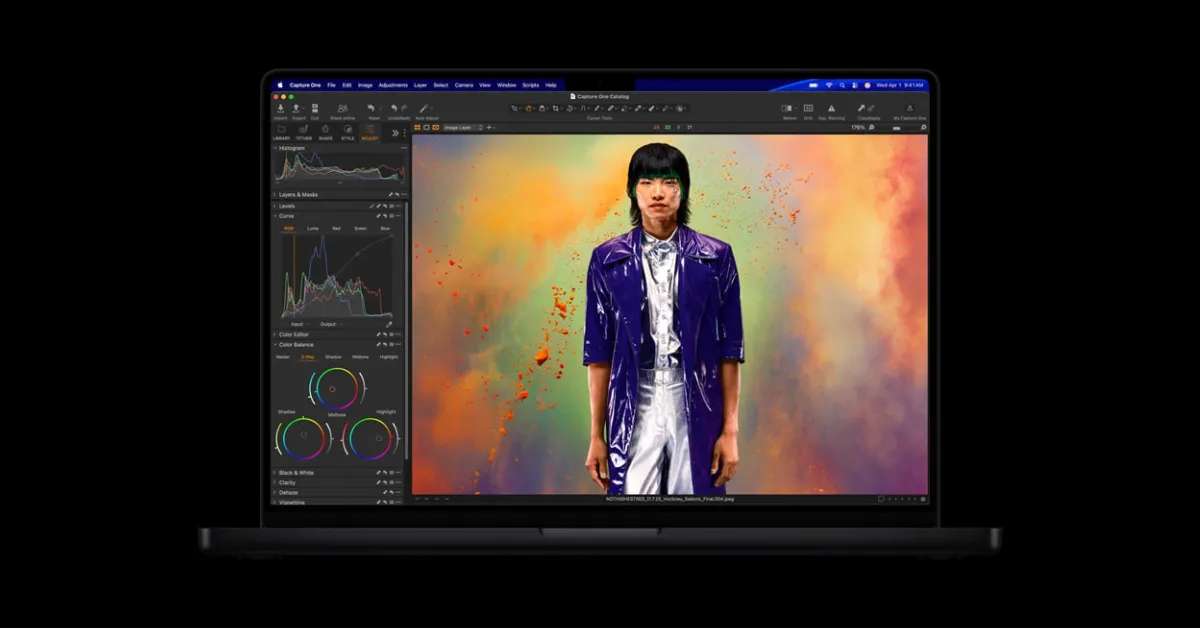

Voici Ollama :

Cela permet à Ollama d'offrir un grand gain de vitesse sur tous les appareils Apple Silicon. Sur les puces M5, M5 Pro et M5 Max d'Apple, Ollama accélère le temps jusqu'au premier token (TTFT) et le taux de production par token (token/seconde) en tirant parti des nouveaux Accélérateurs de Neurones GPU d'Ollama.

Avec cette mise à jour, Ollama indique que l'exécution d'assistants personnels comme OpenClaw et d'agents de codage tels que "Claude Code, OpenCode ou Codex" est désormais plus rapide.

Cependant, Ollama recommande aux utilisateurs de "s'assurer de disposer d'un Mac avec plus de 32 Go de mémoire unifiée", ce qui peut ne pas être le cas pour de nombreux utilisateurs souhaitant exécuter des LLM localement.

Néanmoins, vous pouvez suivre ce lien pour en savoir plus sur Ollama. Si vous souhaitez en savoir plus sur le projet MLX d'Apple, vous pouvez trouver tous les détails ici.

Produits à découvrir sur Amazon

- David Pogue – ’Apple: The First 50 Years’

- MacBook Neo

- Logitech MX Master 4

- AirPods Pro 3

- AirTag (2ème génération) – Pack de 4

- Apple Watch Series 11

- Adaptateur CarPlay sans fil

Commentaires

(5 Commentaires)