Uma das melhores ferramentas para executar modelos de IA localmente em Macs está ainda mais aprimorada. Aqui estão os motivos e como executá-la.

Modelos de IA locais com Ollama agora funcionam mais rápido em Macs com silício da Apple

Se você ainda não conhece o Ollama, trata-se de um aplicativo para Mac, Linux e Windows que permite aos usuários executar modelos de IA localmente em seus computadores.

Ao contrário de aplicativos baseados em nuvem, como o ChatGPT, esses modelos não funcionam localmente e requerem uma conexão com a internet; o Ollama permite que os usuários carreguem e executem os modelos diretamente em suas máquinas.

Esses modelos podem ser baixados de comunidades de código aberto, como o Hugging Face, ou diretamente do fornecedor do modelo.

No entanto, executar LLMs localmente pode ser bastante desafiador, pois mesmo LLMs pequenos e leves tendem a consumir uma quantidade significativa de RAM e memória GPU.

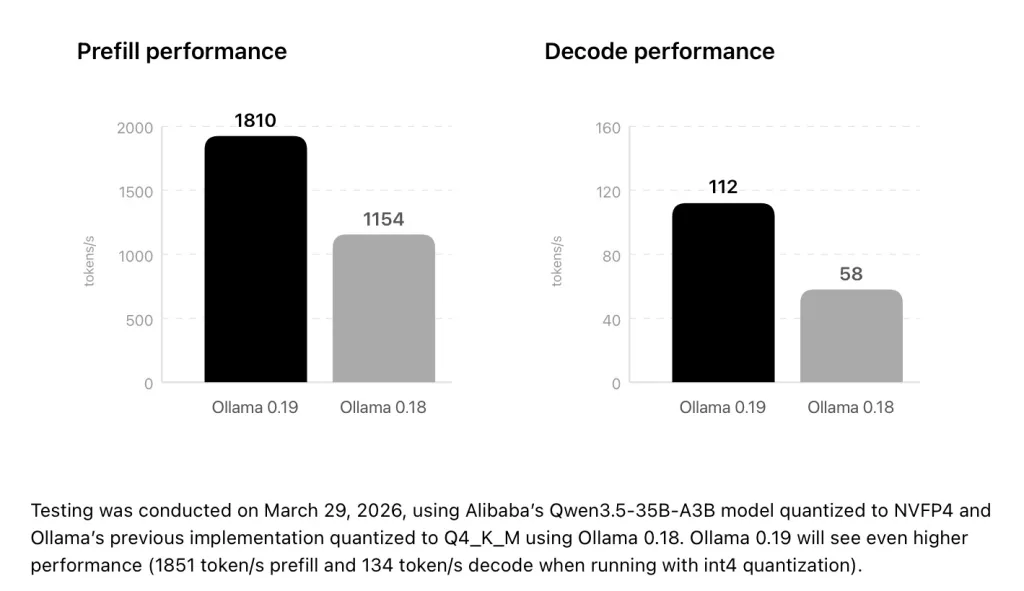

Para superar essa situação, o Ollama lançou a versão de pré-visualização de seu aplicativo (Ollama 0.19), e esta versão "agora foi construída sobre a estrutura de aprendizado de máquina MLX da Apple, permitindo que os modelos de IA locais funcionem mais rápido em Macs com silício da Apple, aproveitando a arquitetura de memória unificada".

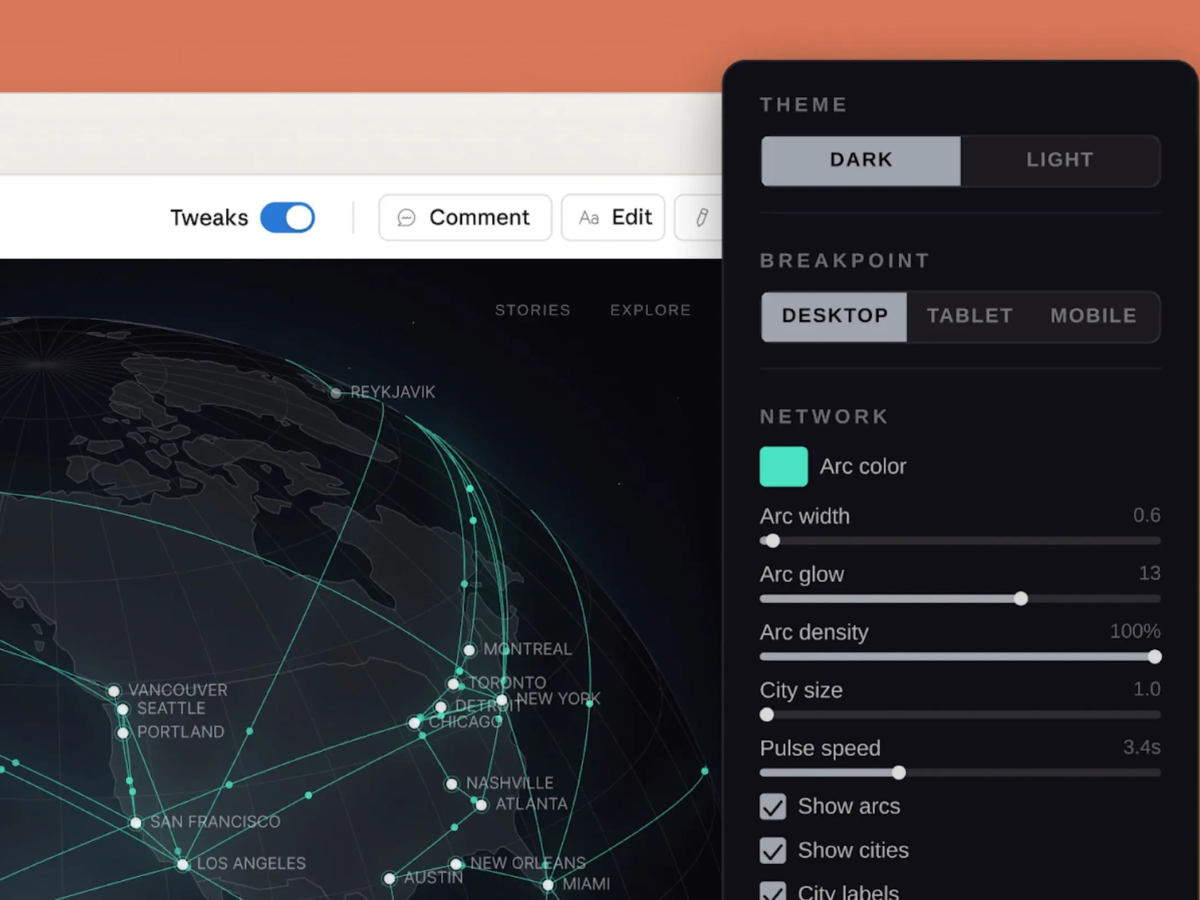

Aqui está o Ollama:

Isso resulta em um grande aumento de velocidade para todos os dispositivos com Apple Silicon. Nos chips M5, M5 Pro e M5 Max da Apple, o Ollama acelera o tempo até o primeiro token (TTFT) e a taxa de produção por token (token/segundo) aproveitando os novos Aceleradores de Rede GPU.

Com essa atualização, o Ollama afirma que agora é mais rápido executar assistentes pessoais como o OpenClaw e "agentes de codificação como Claude Code, OpenCode ou Codex".

No entanto, o Ollama recomenda que os usuários "certifiquem-se de ter um Mac com mais de 32GB de memória unificada", o que pode não ser viável para muitos usuários que desejam executar LLMs localmente.

Ainda assim, você pode seguir este link para saber mais sobre o Ollama. Se você quiser mais informações sobre o projeto MLX da Apple, você pode encontrar todos os detalhes aqui.

Produtos que valem a pena conferir na Amazon

- David Pogue – 'Apple: The First 50 Years'

- MacBook Neo

- Logitech MX Master 4

- AirPods Pro 3

- AirTag (2ª Geração) – Pacote com 4

- Apple Watch Series 11

- Adaptador CarPlay sem fio

![Colecionador da Apple exibe sons de inicialização do Mac de 50 anos [Vídeo]](/resimler/apple-koleksiyoncusu-50-yillik-mac-acilis-seslerini-sergiliyor-video.jpg)

Comentários

(5 Comentários)